Prinsip-prinsip Responsible AI (Kecerdasan Buatan yang Bertanggung Jawab)

Penjelasan dari prinsip-prinsip Responsible AI (Kecerdasan Buatan yang Bertanggung Jawab) dan tantangan yang terkait adalah sebagai berikut:

1. Fairness (Keadilan)

Prinsip Fairness dalam AI : Kecerdasan Buatan harus adil dan tidak menunjukkan bias terhadap individu atau kelompok berdasarkan atribut tertentu seperti jenis kelamin, ras, atau usia.

Tantangan/Risiko: Bias dalam data pelatihan dapat menghasilkan keputusan yang diskriminatif.

Contoh:

- Model persetujuan pinjaman yang memberikan hasil diskriminatif karena data pelatihan memiliki bias terhadap jenis kelamin tertentu.

Implikasi: - Ketidakadilan dalam peluang atau perlakuan, yang dapat menyebabkan ketidakpercayaan pada teknologi AI/Kecerdasan Buatan.

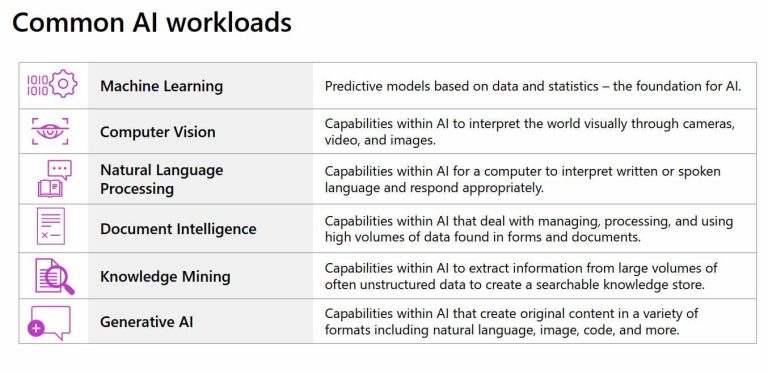

Baca Juga : Common AI Workloads : AI workloads mencakup berbagai jenis tugas

2. Reliability & Safety (Keandalan dan Keamanan)

Prinsip Reliability & Safety : Kecerdasan Buatan harus beroperasi dengan aman dan dapat diandalkan dalam semua kondisi.

Tantangan/Risiko:

Kesalahan dalam sistem AI dapat menyebabkan kerugian fisik, material, atau reputasi.

Contoh:

- Sebuah kendaraan otonom mengalami kegagalan sistem yang menyebabkan kecelakaan.

Implikasi: - Risiko keselamatan publik yang dapat menghambat adopsi AI di masyarakat.

3. Privacy & Security (Privasi dan Keamanan)

Prinsip: AI harus melindungi data pengguna dan memastikan keamanan informasi sensitif.

Tantangan/Risiko:

Data pribadi yang digunakan untuk melatih model dapat terekspos jika tidak dikelola dengan benar.

Contoh:

- Bot diagnostik medis dilatih dengan data pasien sensitif yang disimpan tanpa perlindungan keamanan.

Implikasi: - Pelanggaran privasi yang dapat menyebabkan kerugian hukum dan reputasi.

4. Inclusiveness (Inklusivitas)

Prinsip: AI harus dirancang agar dapat digunakan oleh semua orang, termasuk mereka yang memiliki kebutuhan khusus.

Tantangan/Risiko:

Solusi yang tidak mempertimbangkan keragaman pengguna dapat mengesampingkan kelompok tertentu.

Contoh:

- Aplikasi prediksi yang tidak memiliki output audio, sehingga tidak dapat digunakan oleh penyandang tunanetra.

Implikasi: - Eksklusi kelompok tertentu, yang memperparah ketidaksetaraan teknologi.

5. Transparency (Transparansi)

Prinsip: Sistem AI harus memberikan kejelasan tentang cara kerjanya, termasuk bagaimana keputusan dibuat.

Tantangan/Risiko:

Pengguna kesulitan memahami logika di balik keputusan AI, yang mengurangi kepercayaan.

Contoh:

- Alat keuangan berbasis AI memberikan rekomendasi investasi tanpa menjelaskan logika di balik rekomendasi tersebut.

Implikasi: - Ketidakpercayaan dan resistensi dari pengguna.

6. Accountability (Akuntabilitas)

Prinsip: Harus ada pihak yang bertanggung jawab atas tindakan dan keputusan yang diambil oleh AI.

Tantangan/Risiko:

Sulit menentukan siapa yang bertanggung jawab jika AI membuat keputusan yang salah atau membahayakan.

Contoh:

- Orang tak bersalah dihukum berdasarkan bukti dari pengenalan wajah – siapa yang bertanggung jawab, pengembang perangkat lunak atau pengguna?

Implikasi: - Ketidakpastian hukum yang dapat menghalangi penerapan teknologi AI secara luas.

Pentingnya Prinsip-Prinsip Ini

- Meningkatkan Kepercayaan Publik: Memastikan AI dipahami dan diterima oleh masyarakat.

- Mengurangi Risiko: Mencegah dampak negatif yang mungkin timbul dari keputusan AI.

- Mendorong Adopsi Kecerdasan Buatan yang Bertanggung Jawab: Membantu perusahaan dan pemerintah memastikan penggunaan AI yang etis.